Det här är del 3 av 3 i vår artikelserie om AI i praktiken. Läs också del 1: Vad använder vi det egentligen till? och del 2: Hur fungerar olika modeller?

I de två första delarna har jag pratat om vad vi använder AI till och hur det fungerar. Men det som egentligen spelar roll är inte teorin. Det är hur man använder det i praktiken.

På Tripnet har vi valt att arbeta med AI på samma sätt som vi gör med annan teknik. Vi testar, utvärderar och bygger förståelse över tid. Inte genom att jaga trender, utan genom att se vad som faktiskt fungerar i vår vardag och för våra kunder.

Ett labb, inte en färdig lösning

Vi ser inte AI som en färdig produkt. Vi ser det som ett område där man behöver labba. Det innebär att vi kör egna miljöer, testar olika modeller och bygger lösningar själva. Dels för att förstå tekniken, men också för att kunna ta kontroll över hur den används. Det är en viktig skillnad. Att använda en färdig tjänst är enkelt. Att förstå vad den gör – och vad den inte gör – kräver mer arbete.

Det är också värt att vara tydlig med vad som menas med “toppmodeller” i det här sammanhanget.

De modeller som testas här är inte de största som finns tillgängliga från respektive leverantör. Många modellfamiljer har betydligt större varianter – ofta i storleksordningen hundratals miljarder parametrar – som används när leverantörer jämför sig med tjänster som ChatGPT eller Claude. De modellerna kräver dock en helt annan infrastruktur och är i praktiken oftast inte intressanta att köra lokalt. Tripnet kan leverera större miljöer, men vårt labb har en begränsning på ca 122B. Fokus här är därför på modeller som faktiskt går att använda i praktiken och kostnadseffektivt i en egen miljö, där man har kontroll över data, kostnad och drift.

Det innebär också att jämförelser här handlar om praktisk användbarhet – inte om absoluta toppnivåer i branschen.

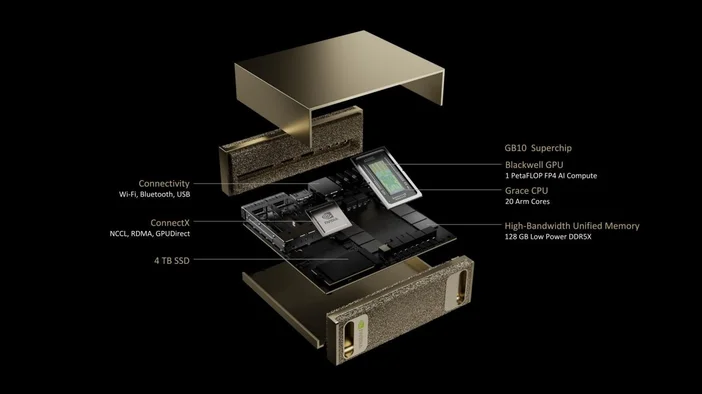

Som en del av Tripnets utvecklings- och utvärderingsarbete har jag satt upp en testmiljö med några olika öppna LLM:er (Large Language Models). Modellerna kommer från några av branschledarna i USA, Kina, Storbritannien, EU och Sverige. Tekniskt använder vi ledande open source-mjukvara: Open WebUI som gränssnitt, Ollama som motor och SearXNG för webbsökningar. Allt detta körs i en Docker-container på en ASUS GX10.

Egen svensk drift förändrar spelplanen

En av de viktigaste insikterna för oss är att när vi kör modellerna själva, på vår egen hårdvara, så förändras förutsättningarna. Vi får kontroll – och med kontroll kommer också möjligheter.

Vi kan använda modeller som vi annars inte skulle välja att använda i en molntjänst. Inte för att de är dåliga, utan för att vi inte vill exponera data i fel sammanhang. Ur ett informationssäkerhetsperspektiv är det en självklar utgångspunkt att vi inte skickar känslig information till miljöer där vi saknar kontroll.

Samtidigt innebär lokal drift att vi kan utvärdera fler modeller. Ett tydligt exempel är Qwen-modellerna från Alibaba, som just nu tillhör de starkare modellerna, särskilt inom kod och tekniska resonemang. När vi kör dem lokalt sker ingen extern kommunikation. Ingen data lämnar vår miljö. Det gör att vi kan använda deras styrkor – men på våra villkor.

Det som kanske skiljer vår approach mest från många andra är att vi inte ser AI som en funktion. Vi ser det som en del av vår driftmiljö. Det innebär att vi hanterar AI på samma sätt som annan verksamhetskritisk IT. Med kontroll, med riskbedömning och med tydliga gränser för vad som får användas var.

Licenser – en fråga man inte kommer runt

När man börjar arbeta med lokala modeller upptäcker man ganska snabbt att “öppen” inte alltid betyder fri. Olika modeller har olika licenser. Vissa är enkla att använda kommersiellt. Andra har begränsningar som man behöver förstå och förhålla sig till. Det här är inte en teknisk detalj. Det är en del av att ta ansvar.

Enklast licensmässigt, modeller med Apache 2.0 eller MIT. De är generellt enklast att använda kommersiellt och brukar ge minst licensfriktion. Hit hör bland annat Qwen, öppna Mistral-modeller, Gemma 4, DeepSeek-varianter, GPT-OSS, GLM-OCR och några mindre communitymodeller.

Öppna, men egna villkor, modeller som är öppna att använda men som inte ligger under en standardlicens som Apache eller MIT. Här behöver du läsa de specifika villkoren lite noggrannare. Hit hör Llama, Gemma 2, Gemma 3, EmbeddingGemma och GPT-SW3.

Kräver extra kontroll, Communityvarianter och derivat där licensbilden kan vara mindre tydlig, eller där metadata och README inte alltid säger samma sak. Hit hör till exempel jaahas/qwen3.5-uncensored och jobautomation/OpenEuroLLM-Swedish.

Vill du ha så lite licensfriktion som möjligt är Apache 2.0- och MIT-gruppen det tryggaste förstavalet. Vill du i stället prioritera språk, ekosystem eller viss modellfamilj kan Llama, Gemma 2/3 och GPT-SW3 fortfarande vara relevanta, men då behöver du ha bättre ordning på licenstext, notice-filer och användningsvillkor.

Från teknik till tjänst

För oss handlar det här inte bara om teknik. Det handlar om att bygga tjänster. AI som körs i kontrollerade miljöer. Där data hanteras på ett sätt som är förenligt med våra krav och våra kunders krav. Där lösningen kan anpassas efter verksamheten. Det är där det blir relevant på riktigt.

För oss handlar det inte bara om AI. Det handlar om var AI körs, under vilken lagstiftning och med vilken kontroll över data. Det är där skillnaden uppstår.

I ett kunduppdrag där vi arbetade med struktur och informationshantering såg vi hur AI kunde användas för att skapa bättre överblick i befintligt material. Det ersatte inte analysen, men gjorde det möjligt att arbeta mer systematiskt och snabbare komma fram till rätt frågor.

Modellerna i vårt AI-lab

I vår testmiljö kör vi i dag ett brett urval av öppna modeller. Inte för att det är ett mål i sig, utan för att de är bra på olika saker. När man testar flera modellfamiljer bredvid varandra blir det ganska tydligt att det finns flera lager.

De tyngsta flaggskeppen använder vi för att förstå var gränserna går. Där finns modeller som devstral-2:123b, qwen3.5:122b, llama4:scout och gpt-oss:120b. Det är modeller som kan hålla ihop långa resonemang, arbeta med större sammanhang och ge mer sammanhängande svar i svårare uppgifter.

Sedan finns mellanklassen. Det är kanske där det mest intressanta händer i praktiken. Modeller som devstral-small-2:24b, magistral:24b, gemma4:26b, gemma4:31b, qwen3.5:27b och gemma3:27b är ofta tillräckligt starka för att vara verkligt användbara, utan att bli lika tunga som de allra största.

Under dem finns mindre arbetsmodeller som är snabba, smidiga och ofta mycket praktiska i vardagen. Där finns till exempel gemma4:e4b, phi4:14b, phi4-reasoning:14b, ministral-3:8b, qwen3.5:9b, deepseek-r1:14b och llama3.1:8b.

Utöver detta har vi specialister. glm-ocr för dokument och OCR. Embeddinggemma för embeddings och sök. Qwen3-coder-next, deepseek-coder-v2 och qwen2.5-coder för kodarbete. Qwen2.5vl och llama4:scout för multimodala flöden med bildstöd. Och svenska modeller som GPT-SW3, OpenEuroLLM-Swedish och Mistral Swedish Flashback när språkkänsla, tonalitet och lokal förankring är viktig.

Det innebär i praktiken att vi inte väljer en modell. Vi väljer flera.

Devstral 2 – agentisk kod och systemförståelse (FRANKRIKE)

Devstral-familjen från Mistral är särskilt intressant när man vill testa AI i tekniska arbetsflöden. Det här är modeller som känns mer riktade mot kod, struktur, verktygsanvändning och större sammanhang än traditionell allround-chat.

devstral-small-2:24b

- Användningsområde: kodassistans, config-filer, Docker Compose, felsökning, systemförståelse och tekniska resonemang.

- Fördelar: bra balans mellan fart och kvalitet; mer realistisk att använda i vardagen än de största modellerna.

- Nackdelar: inte lika djup och uthållig som 123B-varianten.

devstral-2:123b

- Användningsområde: större kodbaser, komplex felsökning, agentiska arbetsflöden och mer avancerad teknisk analys.

- Fördelar: mycket hög kapacitet; stark i längre resonemang och större tekniska sammanhang.

- Nackdelar: tung att köra lokalt; kräver mycket resurser och lämpar sig inte för vardagschatt.

DeepSeek – reasoning och kod (KINA)

DeepSeek R1 är öppna reasoning-modeller från DeepSeek AI, med fokus på logiskt och flerstegsbaserat resonemang. Det här är modeller som ligger högt i kapacitet inom den storleksklass som är praktiskt användbar i en egen miljö.

deepseek-r1:7b

- Användningsområde: snabb reasoning light, enklare logik och mindre analysuppgifter.

- Fördelar: låg resursförbrukning.

- Nackdelar: begränsat djup i svårare problem.

deepseek-r1:14b

- Användningsområde: tekniska analyser, felsökning, strukturstöd och beslutsunderlag.

- Fördelar: bra balans mellan djup och prestanda.

- Nackdelar: når inte hela vägen i de mest komplexa uppgifterna.

deepseek-r1:70b

- Användningsområde: avancerad analys, längre resonemang, systemförståelse och komplex problemlösning.

- Fördelar: starkaste reasoning-varianten i vår DeepSeek-familj.

- Nackdelar: tung och relativt långsam.

deepseek-coder-v2:16b

- Användningsområde: kodgenerering, refaktorering, felsökning och tekniska analyser i kodbaser.

- Fördelar: stark kodmodell för sin storlek.

- Nackdelar: mindre naturlig i generell svensk dialog.

Mistral – europeisk allround och resonemang (FRANKRIKE)

Mistral-familjen är intressant för oss eftersom den kombinerar bra språkförmåga med europeisk förankring. Den känns ofta välbalanserad och användbar.

mistral-small:latest

- Användningsområde: allround-chat, sammanfattningar och textproduktion.

- Fördelar: bra språkflyt och god allmän kvalitet.

- Nackdelar: inte specialiserad för tyngre kod eller djupare resonemang.

magistral:24b

- Användningsområde: längre resonemang, strukturerad analys, tekniska och verksamhetsnära frågeställningar.

- Fördelar: tydlig tänkarmodell i mellanklassen; ofta mer resonemangsorienterad än traditionella allroundmodeller.

- Nackdelar: kräver mer resurser än små vardagsmodeller.

ministral-3:8b

- Användningsområde: snabb vardagschat, enklare multimodala flöden och lättare arbetsuppgifter.

- Fördelar: snabb, smidig och modern liten modell.

- Nackdelar: inte byggd för de tyngsta analyserna.

timpal0l/mistral-swedish-flashback:latest

- Användningsområde: svensk text, tonalitet och experiment kring lokalanpassat språk.

- Fördelar: intressant när språkkänsla på svenska är viktig.

- Nackdelar: mer nischad och mindre allround än de större globala modellerna.

Qwen 2.5 – kod och vision (KINA)

Qwen 2.5-serien använder vi framför allt när vi behöver kod- och multimodal förmåga i mindre och medelstora modeller.

qwen2.5-coder:7b

- Användningsområde: scripts, config, små patchar och enklare utvecklingsuppgifter.

- Fördelar: låg latency och bra i agentliknande flöden.

- Nackdelar: missar ibland detaljer och edge cases.

qwen2.5-coder:14b

- Användningsområde: större koduppgifter, felsökning och refaktorering.

- Fördelar: bättre kodkvalitet än 7B.

- Nackdelar: tyngre att köra.

qwen2.5vl:7b

- Användningsområde: bilder, skärmdumpar, diagram och gränssnittstolkning.

- Fördelar: multimodalitet lokalt.

- Nackdelar: begränsad precision i mindre detaljtunga uppgifter.

Qwen 3.5 – stark allround och tung kodförmåga (KINA)

Qwen 3.5-serien är en av de familjer som imponerat mest i vår miljö. Det en av de mest kapabla öppna modellfamiljerna i den storleksklass som går att köra lokalt eller i en mindre driftmiljö. Den täcker både snabba vardagsmodeller och tyngremodeller för analys och kod.

qwen3.5:9b

- Användningsområde: allround-chat, lättare analys, tekniskt stöd och dokumentation.

- Fördelar: mycket bra balans mellan kvalitet och snabbhet.

- Nackdelar: tappar djup i tyngre resonemang.

qwen3.5:27b

- Användningsområde: robust analys, bättre kodförståelse, längre texter och mer sammanhängande resonemang.

- Fördelar: stark mellanklassmodell; bra balans mellan kvalitet och resurskrav.

- Nackdelar: inte lika stark som de allra största modellerna.

qwen3.5:122b

- Användningsområde: avancerad analys, arkitektur, komplex felsökning och längre produktionsklara texter.

- Fördelar: en av de verkliga flaggskeppsmodellerna i vår miljö.

- Nackdelar: mycket tung att köra lokalt.

jaahas/qwen3.5-uncensored:9b

- Användningsområde: experiment, forskning och tester där man vill förstå hur en mindre filtrerad modell beter sig.

- Fördelar: intressant för att förstå gränserna mellan modell, policy och säkerhetslager.

- Nackdelar: inte lämplig i produktionsmiljö eller externa sammanhang utan tydliga skydd.

– Detta är en ofiltrerad version som väcker en del tankar. Den svarar på frågor som vanliga modeller normalt vägrar besvara. Inte för att någon av oss behöver den typen av innehåll, utan för att det blir tydligt vad som händer när skyddsräcken tas bort. Det väcker intressanta frågor om ansvar, styrning och vilka begränsningar som bör finnas i olika typer av AI-tjänster. Laddade du ner anarkistens kokbok från BBS på 90-talet kommer du att gilla detta.

qwen3-coder-next:Q4_K_M

- Användningsområde: kod, utvecklingsflöden, större tekniska arbetsuppgifter och agentiska scenarier.

- Fördelar: tydligt kodfokuserad modell med hög kapacitet.

- Nackdelar: tung; betydligt mer specialiserad än en vanlig chattmodell.

Llama – generell språkförståelse och multimodala steg framåt (USA)

Llama 3.1 är Meta AI:s öppna modellfamilj för generell språkförståelse. De varianter som används här tillhör de mest kapabla som är realistiska att köra i en egen miljö.

llama3.1:8b

- Användningsområde: snabb chat, brainstorming och enklare analyser.

- Fördelar: bra flyt och lätt att köra.

- Nackdelar: begränsat djup.

llama3.1:70b

- Användningsområde: längre texter och mer komplex analys.

- Fördelar: stark allround-kvalitet.

- Nackdelar: resurskrävande.

llama4:scout

- Användningsområde: avancerad analys, multimodala arbetsflöden, längre sammanhang och större experiment.

- Fördelar: ett tydligt steg upp i ambition; stor och intressant multimodal modell.

- Nackdelar: mycket tung att köra lokalt.

Gemma – från mycket små edge-modeller till kvalificerad analys (USA+UK)

Gemma-familjen har blivit allt mer intressant. Med Gemma 4 spänner den nu från riktigt små modeller till modeller som fungerar för avancerad analys och lokala AI-assistenter.

gemma2:2b

- Användningsområde: klassificering, taggning och korta svar.

- Fördelar: extremt snabb.

- Nackdelar: mycket begränsat djup.

gemma2:9b

- Användningsområde: enklare allround, FAQ och sammanfattningar.

- Fördelar: stabil och resurssnål.

- Nackdelar: tappar tråden i längre uppgifter.

gemma3:12b

- Användningsområde: guider, policies och strukturerad text.

- Fördelar: bra konsekvens.

- Nackdelar: inte toppklass i analys.

gemma3:27b

- Användningsområde: längre dokument och bättre textkvalitet.

- Fördelar: känns betydligt mognare än de mindre Gemma-varianterna.

- Nackdelar: kräver mer resurser.

gemma4:e2b

- Användningsområde: snabb lokal chat och enklare arbetsflöden.

- Fördelar: lätt att köra; låg latency.

- Nackdelar: begränsat djup.

gemma4:e4b

- Användningsområde: vardagsarbete, dokumentstöd och lättare kodning.

- Fördelar: mycket intressant balansmodell.

- Nackdelar: inte tillräcklig för de tyngsta uppgifterna.

gemma4:26b

- Användningsområde: avancerad analys, längre dokument och kodassistans.

- Fördelar: stark mellanklass med bra balans mellan kvalitet och prestanda.

- Nackdelar: kräver tydligt mer resurser.

gemma4:31b

- Användningsområde: längre resonemang, policyarbete och teknisk problemlösning.

- Fördelar: starkaste dense-varianten i familjen hos oss.

- Nackdelar: tyngre än 26B och inte självklar för vardagsbruk.

Svenska och europeiska språkmodeller (SVERIGE/EU)

När språkkänsla, svensk tonalitet eller digital suveränitet är centralt är de svenska och europeiska modellerna särskilt intressanta.

fcole90/ai-sweden-gpt-sw3:1.3b

- Användningsområde: enkel svensk text och klassificering.

- Fördelar: snabb.

- Nackdelar: begränsad kapacitet.

fcole90/ai-sweden-gpt-sw3:6.7b

- Användningsområde: kortare svenska texter och enklare internassistent.

- Fördelar: bättre svensk känsla än många globala modeller.

- Nackdelar: svagare på kod och analys.

fcole90/ai-sweden-gpt-sw3:20b

- Användningsområde: längre svensk text, nyhetsbrev och policyutkast.

- Fördelar: starkaste svenska modellen i familjen hos oss.

- Nackdelar: långsammare och tyngre.

jobautomation/OpenEuroLLM-Swedish:latest

- Användningsområde: svensk allround-chat och sammanfattningar.

- Fördelar: europeiskt spår och intressant svensk ton.

- Nackdelar: kvaliteten känns inte alltid lika jämn som hos de största globala modellerna.

GPT-OSS – öppna modeller från OpenAI (USA)

GPT-OSS är intressanta som öppna allroundmodeller med modern instruktionsföljning och tydlig “assistant-känsla”. Det är dock viktigt att komma ihåg att detta inte är OpenAIs största modeller, utan en öppen variant anpassad för lokal eller kontrollerad drift.

gpt-oss:20b

- Användningsområde: textproduktion, sammanfattningar, analys och tekniska resonemang.

- Fördelar: hög kvalitet i förhållande till storlek.

- Nackdelar: når inte lika långt som de allra största tänkarmodellerna.

gpt-oss:120b

- Användningsområde: avancerad analys, längre dokument och komplex problemlösning.

- Fördelar: tillhör flaggskeppen i vår miljö.

- Nackdelar: mycket resurskrävande.

OCR, embeddings och specialister

Alla modeller är inte till för klassisk chat. Några används snarare som komponenter i en större AI-miljö.

glm-ocr:latest

- Användningsområde: OCR, dokumentförståelse, skärmdumpar och visuellt material.

- Fördelar: tydlig specialistmodell som fyller en annan roll än vanliga språkmodeller.

- Nackdelar: inte en generell allroundmodell.

embeddinggemma:latest

- Användningsområde: embeddings, semantiskt sök och RAG-liknande arbetsflöden.

- Fördelar: viktig byggsten i informationssökning och kunskapsstöd.

- Nackdelar: används inte som vanlig chattmodell.

Några reflektioner

Det här arbetet har gett oss några ganska tydliga insikter.

För det första: Det finns ingen “bästa modell”.

Det finns modeller som är bra på olika saker:

- resonemang

- kod

- språk

- dokument

- hastighet

För det andra: Storlek är inte allt.

I många fall är en modell på 8–14B mer användbar än en på 70–120B.

För att den är snabb nog att faktiskt använda.

För det tredje: Kontroll spelar roll.

När modeller körs lokalt kan vi välja:

- vilken modell vi använder

- vilken data som används

- hur informationen hanteras

Det är en helt annan nivå av kontroll än i publika molntjänster.

Alltid utgångspunkten: Höga krav – säker leverans.

Det handlar om att välja rätt verktyg för rätt uppgift. I vissa fall är det en molntjänst. I andra fall är det en lokal modell. Ibland är det en kombination. Avslutningsvis, det är kanske den viktigaste insikten av alla.

– Jag får aldrig sluta tänka själv.

Marcelo Caseres, säkerhetschef på Tripnet.

Det är också där vi landar. AI är inte en modell. Det är inte en leverantör. Det är ett sätt att arbeta. Precis som med all annan teknik handlar det inte om att välja det som är “bäst” i teorin, utan det som fungerar i praktiken – i den miljö, med de krav och med den kontroll som verksamheten faktiskt behöver.

Du har läst del 3 av 3 i vår artikelserie om AI i praktiken.

Missade du någon del? Läs del 1: Vad använder vi det egentligen till? och del 2: Hur fungerar olika modeller?