Microsoft 365 är, enligt mig, det bästa "smör & bröd"-verktyget som finns för informationshantering, dokument, kalkyler, presentationer, samarbete och struktur i vardagen. Vi på Tripnet använder självklart Microsoft 365. Det är kraftfullt, integrerat och i dagsläget väldigt svårt att ersätta på ett rimligt sätt. Just därför behöver vi också vara extra uppmärksamma när tjänsten förändras.

– Det här handlar alltså inte om att svartmåla amerikanska molntjänster. Det handlar inte heller om att säga att ingen ska använda Microsoft 365. Tvärtom. Det handlar om något mycket mer praktiskt: att förstå vad vi faktiskt tackar ja till, vad som är påslaget som standard och vilka informationssäkerhetsbeslut vi i praktiken redan har fattat utan att kanske tänka på det.

Två nya exempel som borde få fler att stanna upp

Jag har nyligen fått information från Microsoft om två förändringar kopplade till Copilot.

Den första gäller Anthropic-modeller i Copilot i Word, Excel och PowerPoint. Microsoft har infört en administrativ inställning som gör att Anthropic-modeller kan användas som standard i dessa appar. Den här inställningen kan vara påslagen som standard, beroende på hur tenant och överordnade AI-inställningar är konfigurerade. Därför behöver varje organisation kontrollera sitt eget läge. Microsoft är samtidigt tydliga med att när dessa modeller används sker databehandlingen utanför Microsofts EU Data Boundary, alltså Microsofts datagräns för EU. För Excel och PowerPoint gäller detta från 4 maj 2026, och stöd för Word ska läggas till under sommaren 2026. Microsoft beskriver också att Anthropic agerar som underprocessor under Microsofts produktvillkor och DPA.

Den andra förändringen gäller så kallad flex routing. Där säger Microsoft att AI-bearbetning under perioder av hög belastning kan flyttas utanför Microsofts datagräns för EU, för att upprätthålla en jämn Copilot-upplevelse. Enligt Microsoft kan detta, när flex routing är aktiverat, innebära bearbetning i USA, Kanada eller Australien. Den här förändringen börjar gälla 17 april 2026.

Microsoft beskriver själva förändringen så här:

How this will affect your organization:

Who is affected:

- Tenants using Microsoft 365 Copilot and Copilot Chat, and Copilot experiences in Dynamics 365, Power Platform, and Copilot Studio.

- Tenants in the European Union (EU) and European Free Trade Association (EFTA).

What will happen:

- The flex routing setting is now available in the Microsoft 365 admin center.

- Flex routing is enabled by default for your tenant, but routing changes will not take effect until April 17, 2026.

- During periods of peak demand, LLM inferencing calls may be routed outside the EU Data Boundary if you choose to keep the default flex routing setting.

Det är inte tekniken som stör mig – det är default-valet.

Det som får mig att reagera är inte i första hand att funktionerna finns. Jag förstår varför Microsoft gör detta. De vill ha kapacitet, flexibilitet och en bra användarupplevelse. Det är logiskt ur deras perspektiv.

Det som skaver är att sådana här förändringar riskerar att bli osynliga styrsignaler i en miljö där många redan försöker göra rätt. Vi skriver AI-policyer. Vi tar fram riktlinjer för etisk AI. Vi arbetar med informationsklassning, riskbedömning och dataskydd. Vi tänker att vi har gjort ett genomtänkt val när vi placerar information i EU.

Och så visar det sig att AI-bearbetningen ändå kan hamna utanför Microsofts datagräns för EU om vi inte själva går in och ändrar default-valet.

– Här tycker jag att man måste stanna upp.

– För det här är inte bara en teknisk detalj. Det är governance. Det är informationssäkerhet. Det är regelefterlevnad. Och det är i många verksamheter också en fråga om förtroende.

“Data lagras i EU” räcker inte alltid som svar

Microsoft är tydliga med att data fortsatt krypteras och att data i vila som huvudregel ligger kvar inom Microsofts datagräns för EU, med vissa undantag för begränsade pseudonymiserade data i samband med flex routing. De är också tydliga med att Copilot inte använder kunddata, prompts eller svar för att träna grundmodellerna. Det är viktigt, och det ska sägas.

– Men för mig räcker det inte att bara fråga var informationen lagras. Jag måste också fråga var den bearbetas, av vem, under vilken jurisdiktion och med vilka avtalsmässiga och organisatoriska konsekvenser.

– Här går jag från fakta till tolkning, och det tycker jag att man ska vara tydlig med: min bedömning är att många organisationer fortfarande tänker för mycket i termer av lagringsplats och för lite i termer av faktisk processering, styrning och förändringshantering. Det blir extra viktigt när AI-funktioner byggs in direkt i de verktyg vi använder varje dag.

Vi måste orka hålla två tankar i huvudet samtidigt

1. Den ena tanken

Är att Microsoft 365 är ett fantastiskt verktyg.

– Jag tycker verkligen det. För dokumenthantering, kalkyler, presentationer, samarbete, e-post och struktur är det svårt att slå. Det gör mig effektiv. Microsoft har dessutom byggt Copilot inom sina ordinarie åtaganden för integritet, säkerhet och regelefterlevnad.

2. Den andra tanken

Är att vi inte får bli så bekväma att vi slutar läsa det som faktiskt förändras.

– När Microsoft lägger till nya AI-leverantörer, nya processvägar eller nya standardval behöver någon i organisationen förstå vad det betyder. Inte bara tekniskt, utan också verksamhetsmässigt.

– Passar detta vår riskaptit? Passar det vår AI-policy? Passar det våra kundåtaganden? Passar det våra interna regler för vilken information som får behandlas var?

– Det är där det verkliga säkerhetsarbetet börjar.

Det här borde varje organisation göra nu

Om ni använder Microsoft 365 Copilot tycker jag att ni bör börja med fyra frågor:

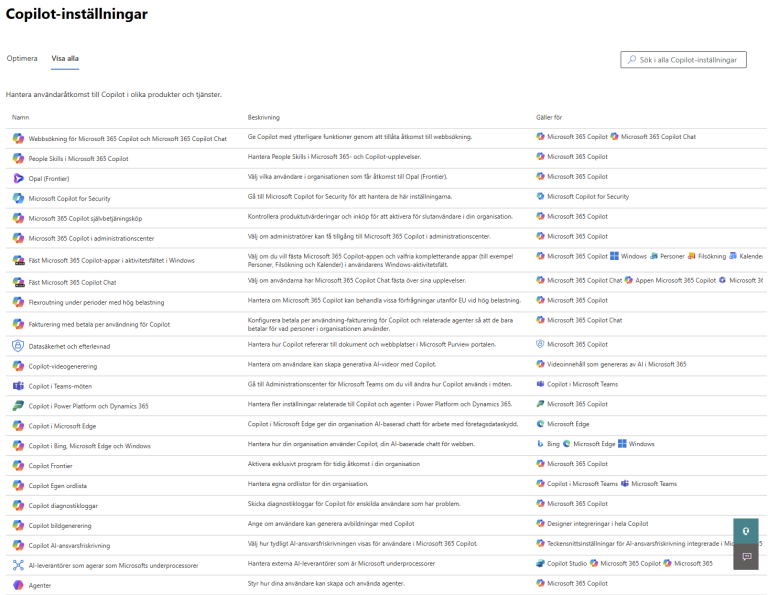

1. Har vi koll på vilka AI-inställningar som faktiskt är aktiverade?

Microsoft rekommenderar själva att administratörer granskar både inställningen för Anthropic-modeller och inställningen för flex routing i Microsoft 365 Admin Center.

2. Är våra nuvarande val förenliga med våra egna regler?

Många organisationer har redan interna riktlinjer för AI, dataskydd och informationsklassning. Då måste Copilot-konfigurationen också passa in där.

3. Vet vi vem som äger frågan internt?

Är det IT? Informationssäkerhet? Dataskydd? Compliance? Verksamheten? Sanningen är att det ofta är alla samtidigt. Då behöver någon samordna.

4. Har vi en process för att fånga upp förändringar från leverantören?

Microsoft 365 förändras hela tiden. Den som använder plattformen professionellt behöver också ha ett sätt att läsa, värdera och besluta kring de förändringarna. Annars blir standardinställningen detsamma som din strategi, och det är sällan ett bra sätt att styra verksamhetskritisk information.

Det här är inte ett nej. Det är ett krav på medvetenhet.

– Jag menar inte att man ska sluta använda amerikanska molntjänster. Jag menar inte heller att man måste säga nej till Copilot. Men jag menar att man måste förstå vad man gör.

– När AI-funktioner blir allt mer integrerade i våra vardagsverktyg räcker det inte att lita på att allt sker där vi tror. Vi behöver läsa det finstilta, förstå arkitekturen, granska standardinställningarna och fatta aktiva beslut.

– För i slutändan är det inte Microsoft eller någon annan som äger din risk – det gör du.

– Det innebär att jag ibland väljer Copilot, ibland Gemini, ofta ChatGPT eller mina egenproducerade AI-tjänster "made in Gothenburg".