I en fullsatt VIP-salong på Bergakungen drar Ulf i gång introt till Terminator. Vi är dock inte här för en biovisning. Vi på Tripnet firar valborg med en kunskapsfrukost om ansvarsfull och etisk AI. Dagens talare, ISO-revisorn Ann-Sofie Gustafsson, avbryter Ulf och förklarar att AI inte är en leksak.

SamCert först med ISO 42001 i Europa

Ann-Sofie och Ulf träffades genom att hon och hennes företag, SamCert, hjälpte Tripnet med sin ISO 27001-certifiering. De båda är väldigt intresserade av AI. I Ann-Sofies fall märks detta tydligt då SamCert var först i Europa och tvåa i världen med att certifiera sig enligt ISO 42001, en standard som handlar om just AI-etik. SamCert har också en AI-policy för företaget, något som Ann-Sofie tycker att andra företag bör ta efter.

Vadå etisk och ansvarsfull AI?

AI är ett brett och komplicerat ämne, som är högst relevant och viktigt att arbeta med. Med etisk och ansvarsfull AI menar man på vilket sätt det är lämpligt att använda sig av AI. Vilka risker och möjligheter för det med sig? Vad är okej användning och vad är förbjudet? Ann Sofie förklarar att vi redan har koll på etik och ansvar, och att det gäller att applicera våra värderingar även på användandet av AI.

Human Centered AI

Begreppet Human Centered AI innefattar AI som gagnar människan på olika sätt. Denna typ av AI kan man träffa på inom många områden. I samband med rekrytering har många företag börjat ta hjälp av AI-verktyg för att få en rekrytering utan fördomar, och se till att de anställer personer utifrån relevanta kriterier. Inom utbildningssektorn finns det också flera användningsområden. Ann-Sofie säger att man till exempel kan använda sig av AR (argumented reality) för att i kemiundervisningen visualisera och titta närmare på till exempel molekyler. Ulf ser AI som en hjälpreda som kan förklara, och som inte tröttnar när man inte förstår.

– Till exempel om man ska hjälpa barnen med matte, och de inte alls lär sig samma tekniker som man själv gjorde. AI tröttnar inte som pappa kan göra, säger han.

EU:s förordning – AI Act

EU är först i världen på att reglera AI, och gör det med en förordning som nu har trätt i kraft. AI ska vara säkert, säger Ursula von der Leyen under en av alla AI summits som varit. Syftet är att skydda oss och våra mänskliga rättigheter.

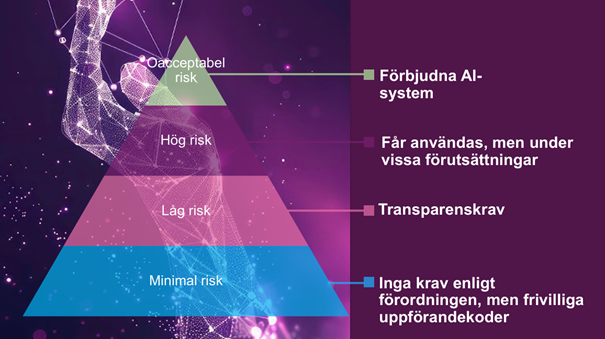

Riskindelning enligt förordningen

AI-system delas in i olika fyra risknivåer:

- Oacceptabel risk:

System som numera är förbjudna i EU. Dessa kan tillexempel vara massövervakning. Ulf drar en parallell till Black Mirror och avsnittet Nosedive, som går ut på att man hela tiden betygsätter varandra i samhället, och att ens betyg avgör ens liv. Ett litet misstag och hela ditt liv kan gå utför. Den hemska framtidsvision som speglas i Nosedive är nu verklighet i Kina, där det finns Social Rating-appar som avgör status och om man till exempel får ta lån. Ann-Sofie flikar in att det är bland annat just sådana appar som utgör en oacceptabel risk, och som därmed är förbjudna i EU. - Hög risk:

Högrisksystem får användas, men bara under vissa förutsättningar. System som beräknas ha en hög risk är till exempel sådana som behandlar känsliga uppgifter. Även självkörande bilar räknas som högrisksystem. - Låg risk:

System som medför en låg risk är till exempel så kallade LLM:er, large language models. Ett exempel på en LLM är ChatGPT. De beräknas inte ha särskilt hög risk, men har ändå ett transparenskrav. - Minimal risk:

Till minimal risk hör bland annat spamfilter på datorn och röststyrda assistenter som Siri och Alexa. De har inga krav enligt förordningen, utan bara frivilliga uppförandekoder.

AI literacy – att ha den kunskap som krävs

Förordningens fjärde artikel behandlar AI literacy. Det innebär att alla som jobbar med AI ska ha tillräcklig kunskap för att kunna se möjligheter och risker med det. Att AI kommer att bli mer intelligent än vi är en skrämmande tanke, men den kan också ge oss många spännande möjligheter. Ulf berättar att man på Tripnet har haft AI-workshops och pratar mycket om AI. Alla ska kunna använda AI, och få möjlighet att utveckla sig inom ämnet.

– Den största AI-risken är att hamna efter och inte utvecklas, menar Ann-Sofie.

Ulf pratar också om vikten av att förstå det man får ut, och att inte lita blint på att det som står stämmer eftersom AI ibland har fel. Man får inte sluta tänka och sätta sig in i saker.

– AI ökar mänsklig förmåga, men också mänsklig oförmåga, säger han.

Vi kan inte heller ansvara 100% för vad AI gör, eftersom vi inte vet varifrån idéerna kommer och inte kan garantera att det inte är copyrightat material. Det gör ansvarsfrågan väldigt komplicerad, säger Ann-Sofie.

Inte en traditionell programvara

AI-system är inte som en traditionell programvara, utan är en autonom teknik som ”tänker” av sig själv, förklarar Ann-Sofie. En vanlig programvara följer en kod till punkt och pricka, det gör inte ett AI-system. Vi vet inte vad som händer i ett AI-system, eller hur vi får ut det vi stoppar in, detta benämns som black box-syndromet. AI-system är som svarta lådor, där vi inte vet exakt vad som händer.

Fördomar och bias – inte bara hos människor

Även om många företag använder AI till en fördomsfri rekrytering, så är AI faktiskt inte alls fri från fördomar. Ann-Sofie berättar att hon har bett ChatGPT generera en bild utifrån hennes LinkedIn-profil, där hon blev en man med skägg. Detta är för att det är AI:ns bild på hur en ISO-revisor skulle se ut. Alla hennes LinkedIn-kompisar som gjorde samma sak fick en bild på en man med skägg i olika variationer. Inte en enda av dem blev en kvinna. Detta visar starkt på att även AI har problem med bias, alltså förutfattade meningar. Detta är troligtvis då den endast tränat på att män jobbar med den typen av saker. Microsofts Copilot ville däremot inte generera någon bild, då den ansåg det som fördomsfullt.

ISO 42001 – standardens scopes

Inom ISO 42001 delas företagen upp i olika kategorier. Man kan tillhöra flera kategorier på samma gång.

- Producers:

Producers är de företag som utvecklar nya AI-modeller, och tränar dem från grunden. Till exempel Volvo, Spotify och Tesla räknas till kategorin. Tesla gör ju inte heller bara bilar, utan utvecklar AI-system till humanoida robotar, som till exempel ska kunna utföra hushållarbete. - Providers:

Providers tillhandahåller eller hostar systemen, exempel är Open AI, AWS och Google. - Developers:

De som utvecklar AI-agenter eller andra AI-system utifrån modellerna. Exempel är Microsoft och Cognizant, som är det företag som hann före SamCert med att bli certifierade för ISO 42001, med bara två dagar. - Users:

I denna kategori hamnar alla som köper och använder systemen. Till exempel H&M, SamCert, AirBnb och Uber.

Standardens nio målområden:

ISO 42001 har nio målområden, du kan läsa mer om dessa här.

- Rättvisa

- Ansvarsskyldighet

- Transparens

- Förklarbarhet

- Tillförlitlighet

- Säkerhet

- Robusthet och redundans

- Integritet och informationssäkerhet

- Tillgänglighet

Hållbar AI: Use, misuse och abuse

Det finns tre termer som är väldigt bra att kunna när man diskuterar användning av AI.

USE: användning som det är tänkt.

MISUSE: felaktig användning, oftast av misstag.

ABUSE: användning som totalt strider mot syftet, och som kan vara skadlig.

Exempel på skadlig användning av AI kan vara AI-genererade nakenbilder, bedrägerier av olika slag och deepfakes på till exempel politiker. Som exempel tar Ann-Sofie upp när felaktig användning AI fick dödliga konsekvenser. En person skrev till en chattbot och berättade att hen ville ta sitt liv. I stället för att ge länkar till suicidpreventionsresurser svarade chattboten med att hen skulle göra det, och gav en lista på olika tekniker. Vems fel är det egentligen? I detta fall lär det vara tillverkaren. Vi kan inte skylla på AI, utan måste ha koll på vad den får säga och inte, och var gränserna går.

AI – en ny industriell revolution

Ann-Sofie menar att AI är en ny industriell revolution, och att vi är med och formar framtiden.

– Nu har vi möjlighet att påverka, nu är det vi som utvecklar framtiden, säger hon hoppfullt.

TIPS:

- Läs om AI! Boken AI för nybörjare av Johan Falk rekommenderas.

- Utforska AI tillsammans, på företaget och privat.

- Ha workshops på företaget, när ni pratar om AI.

- Ha AI-utbildningar och möten regelbundet.

- Sätt upp personliga AI-mål.

TRIPNETS UTBILDNINGAR OCH WORKSHOPS:

Välkommen till utbildning och workshop med Ann-Sofie Gustafsson från Samcert för att komma igång med ansvarsfull AI.

Du kommer att lära dig om de fyra scope i ISO 42001 för att förstå var din verksamhet passar in: Producer, Provider, Developer eller User. Du kommer också att lära dig hur du genom en riskanalys identifierar de viktigaste målområdena: Rättvisa, Ansvarsskyldighet, Transparens, Förklarbarhet, Tillförlitlighet, Säkerhet, Robusthet och redundans, Integritet och informationssäkerhet samt Tillgänglighet.

📅 Datum: 5:e juni / 11:e juni

🕗 Tid: 08:00 – 11:00

☕ Frukost: Serveras från 07:30

📍Plats: Tripnet, Åvägen 40, Göteborg

💳 Kostnad: 995 kr